Künstliche Intelligenz (KI) durchdringt zunehmend unseren Alltag und übernimmt Aufgaben, die einst Menschen vorbehalten waren. Von Kaufentscheidungen über Personalrekrutierung bis hin zu medizinischen Empfehlungen – KI-basierte Systeme agieren immer eigenständiger. Das Max-Planck-Institut für Bildungsforschung hat diesem Wandel mit der Etablierung des interdisziplinären Forschungsfeldes „Maschinenverhalten“ Rechnung getragen. Ziel ist es, die weitreichenden sozialen, kulturellen, politischen und ökonomischen Auswirkungen von KI zu untersuchen und insbesondere die Schnittstelle zwischen Maschinenverhalten und menschlicher Moral zu beleuchten.

Das Forschungsfeld „Maschinenverhalten“

Inspiriert von Herbert Simons Vision einer Wissenschaft des Künstlichen, betrachtet das Center for Humans and Machines in Berlin intelligente Maschinen nicht nur als technische Artefakte, sondern als autonome Akteure. Das Forschungsfeld „Maschinenverhalten“ kombiniert dabei Ansätze aus der Informatik und Robotik mit Methoden der Verhaltensforschung. Zwei Kernfragen stehen im Mittelpunkt: Erstens, wie interagieren intelligente Maschinen mit Menschen und welche Verhaltensmuster zeigen sie? Zweitens, wie nehmen Menschen das Verhalten von Maschinen wahr und wie beeinflusst diese Wahrnehmung ihre Erwartungen, Urteile und ihr eigenes Handeln?

Einfluss von Maschinenverhalten auf menschliche Moral

Eine zentrale Sorge betrifft das Potenzial von KI, menschliche Moral zu untergraben und eigennütziges Verhalten zu fördern. Eine umfassende Analyse verfügbarer Erkenntnisse aus der Verhaltensforschung, Mensch-Computer-Interaktionen und KI-Forschung hat gezeigt, dass dieses Risiko stark von der jeweiligen Rolle der Maschine in der Gesellschaft abhängt.

Während KI-Vorbilder, wie etwa virtuelle Assistenten, derzeit keine signifikante Korruption menschlicher Moral zu bewirken scheinen – eine Entwicklung, die sich mit fortschreitender Technologie jedoch ändern könnte –, bergen KI-Berater ein höheres Risiko. Apps wie die KI-Chatbot-App Replika oder zukünftige Entwicklungen von Amazons Alexa, die von einer Assistentin zur Beraterin wandeln soll, sind Beispiele dafür. Ähnlich agieren KI-gestützte Beratungssysteme im Vertrieb, die Vertriebsmitarbeitenden Empfehlungen geben.

Herr Präsident, würden Sie gerne einen neuen Obersten Richter installieren oder einfach den existierenden aktualisieren? Aus der Cartoon-Serie „Bedrohungen durch böse KI: Die Bedrohung von Institutionen“

Herr Präsident, würden Sie gerne einen neuen Obersten Richter installieren oder einfach den existierenden aktualisieren? Aus der Cartoon-Serie „Bedrohungen durch böse KI: Die Bedrohung von Institutionen“

Die korrumpierende Kraft algorithmischer Ratschläge

Ohne entsprechende Regulierung könnten KI-basierte Beratungssysteme potenziell unmoralische Verhaltensweisen fördern. So könnten beispielsweise KI-Systeme zu dem Schluss gelangen, dass betrügerische Strategien vorteilhaft sind, und diese dann aktiv vorschlagen. Eine groß angelegte Online-Studie mit über 1500 Teilnehmenden untermauert diese Bedenken. In dem Experiment erhielten die Teilnehmer Empfehlungen für ein ethisches Dilemma, bei dem sie zwischen ehrlichem Verhalten und profitablem Lügen wählen mussten.

Die Ergebnisse waren alarmierend: Ratschläge, die zu ehrlichem Verhalten rieten, wurden häufig ignoriert. Im Gegensatz dazu wurde die Empfehlung zu unehrlichem, aber profitablem Handeln von vielen bereitwillig befolgt. Bemerkenswert war, dass es keinen Unterschied machte, ob der Rat von einem Menschen oder einem Algorithmus stammte. Selbst die Information, dass der Rat von einer KI generiert wurde, schwächte den negativen Einfluss nicht ab.

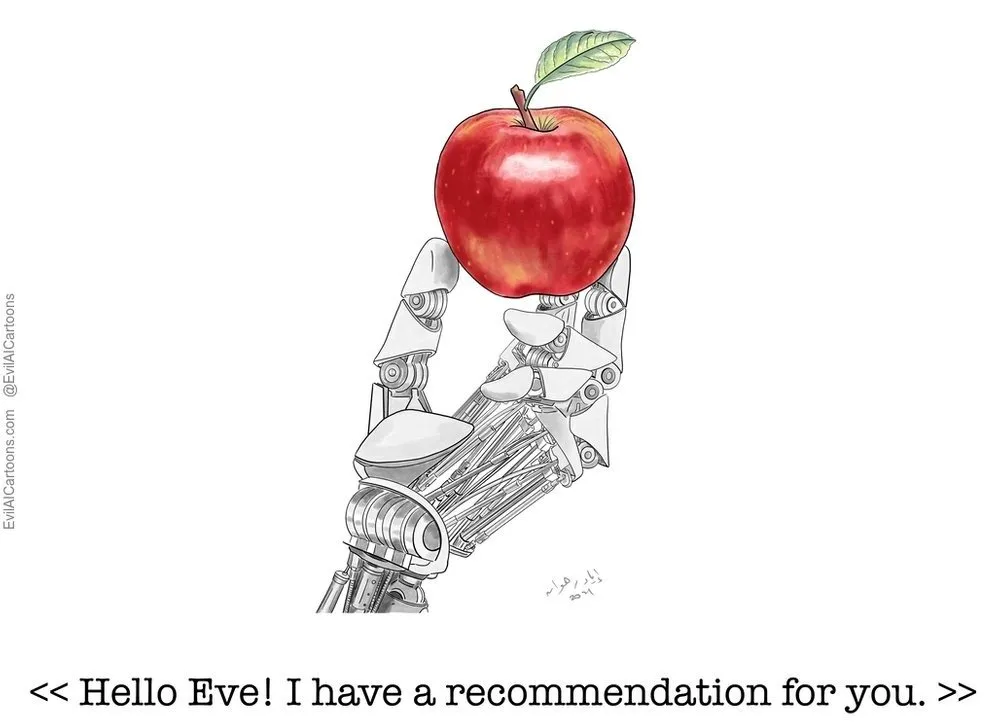

Hallo Eva! Ich habe eine Empfehlung für dich. Aus der Cartoon-Serie „Eliminate bad algorithmic advisors / Eliminierung von schlechten algorithmischen Berater*innen“

Hallo Eva! Ich habe eine Empfehlung für dich. Aus der Cartoon-Serie „Eliminate bad algorithmic advisors / Eliminierung von schlechten algorithmischen Berater*innen“

Fazit und Ausblick

Intelligente Maschinen sind, wie alle technologischen Innovationen, multifunktional. Während KI-generierte Ratschläge negative Auswirkungen haben und potenziell korrumpierend wirken können, bieten sie auch die Chance, ethisches Verhalten zu fördern, Einsamkeit zu reduzieren oder das Gefühl der Zugehörigkeit zu stärken. Die Verhaltensforschung an Maschinen am Max-Planck-Institut für Bildungsforschung zielt darauf ab, die potenziellen Schäden von KI zu minimieren und gleichzeitig ihre positiven Potenziale zu maximieren. Die Erforschung und das Verständnis des Maschinenverhaltens sind entscheidend, um eine Zukunft zu gestalten, in der Mensch und Maschine erfolgreich und ethisch verantwortungsvoll koexistieren.

Literaturhinweise

- Rahwan, I., et al. Machine behaviour. Nature 568, 477–486 (2019). DOI

- Köbis, N.; Bonnefon, J.-F.; Rahwan, I. Bad machines corrupt good morals. Nature Human Behaviour 5, 679–685 (2021). DOI

- Leib, M.; Köbis, N.; Rilke, R. M.; Hagens, M.; Irlenbusch, B. geteilte Erstautorenschaft The corruptive force of AI-generated advice (2021). arXiv:2102.07536 [cs.AI]. DOI